Cuando abres tu app de fotos en el movil y buscas «cumpleaños», o «gato» o «Manolo»… no te causará sorpresa que a los pocos instantes tengas delante una selección de fotos de celebraciones, de gatos o de Manolos.

Sin embargo, para que tu “teléfono”, sepa en qué foto hay gatos y en que fotos no, hay un proceso bastante complejo que sucede en la trastienda.

¿Qué les identifica? ¿Tienen 4 patas? ¿Orejas, bigotes, tiene cola?

ESO no siempre se ve en una foto

¿Son blanditos, ronronean?.

ESO JAMÁS se ve en una foto.

Entones ¿por qué sabe el teléfono que lo que sale en la foto es un gato?

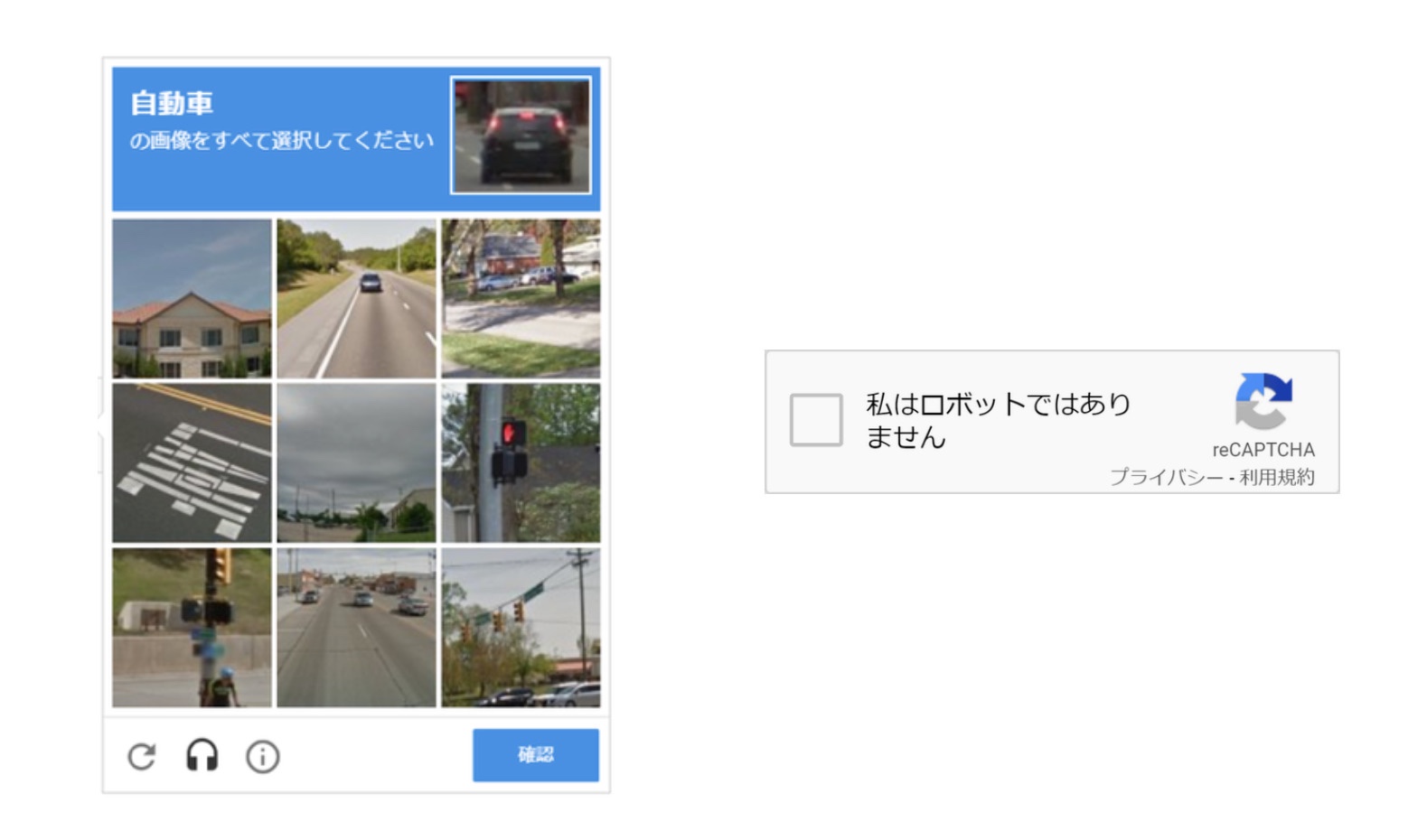

Para que eso ocurra, es necesario entrenar a una Inteligencia Artificial (AI).

Se trata de realizar un Aprendizaje Automático (Machine Learning) a base de enseñar miles, cientos de miles de fotografías a un “ordenador”.

Las primeras veces, se le indica cuando es un gato y cuando no.

En las siguientes, se le deja decidir y se le indica si ha acertado o no.

A medida que se va ejercitando, su nivel de aciertos roza el 100%.

Da igual que lo entrenes con gatos, con personas, con plantas… con lo que sea.

Una vez que el algoritmo está suficientemente entrenado, ya trabaja de forma desatendida.

En ciertas modalidades, si recibe feedback (humano o de otra máquina), seguirá perfeccionándose.

La cuestión relevante en este momento es que la máquina toma una decisión (es gato o no), en base a un entrenamiento, pero DESCONOCEMOS cuál es el proceso que le ha llevado a decidir porqué en cada caso concreto considera si es gato o no.

Como comenté antes no sabemos si se fija en la cola, en las orejas, en el perfil, o cómo combina estas vista…

No tenemos NI IDEA, ni tenemos forma de saberlo, por la inmensidad de cálculos que puede llegar a hacer en milésimas de segundo; no hay posibilidad de supervisar o auditar el proceso de la toma de decisión.

Por eso es por los que estos procedimientos de llaman de CAJA NEGRA: metemos unos datos y obtenemos una decisión, pero no hay justificación alguna:

En jerga técnica, una caja negra es cuando un sistema es visto principalmente por sus características de entrada y salida. Un algoritmo de caja negra es uno donde el usuario no puede ver el funcionamiento interno del algoritmo. Se trata de un sistema bastante polémico, por el hermetismo que contienen y la falta de transparencia, si bien sus creadores lo defienden como un sistema de seguridad y privacidad para evitar filtraciones de datos y competencia desleal. Otra característica de este tipo de algoritmos es su dinamismo, suelen presentar constantemente cambios con el objetivo de adaptarse al ritmo creciente de la tecnología y ofrecer valor a sus usuarios.

Hay casos muy, muy curiosos de decisiones que tienen sorprendidos incluso a sus «creadores»

Una AI, determina con enorme precisión (97%) el sexo de una persona por el iris.

No se sabe cómo lo hace, ni qué analiza.

Los científicos están desconcertados.

Otra AI, determina la raza con similar precisión (94%) con sólo mostrarle una radiografía parcial de un sujeto.

No se sabe cómo lo hace ni qué analiza.

Los científicos están desconcertados.

Otras AI detectan posibles melanomas, predicen estructuras de proteínas y sus interacciones…

La información de nuestras fotos de nuestros gatos y dónde las tomamos, las palmeras, las personas que tenemos en nuestro carrete de fotos, las personas con las que interactuamos, con las que estamos en la calle, nuestros ingresos, nuestros desplazamientos, nuestros viajes, el uso de nuestras tarjeta de crédito o débito, nuestros hábitos online y offline, nuestro trabajo… esa información la analizan los sistemas de Machine Learning, que sacan patrones y patrones.

Unos sistemas mucho, muchísimo más potentes y que van aún mas por libre, los Deep Learning utilizan toda esa información generada y en base a ellas toman decisiones.

Porque hay algoritmos simples de recomendación como los que utilizan Netflix, Spotify o Amazon, pero los más complejos deciden o pueden decidir si conceder un crédito o una hipoteca, autorizar o no un tratamiento médico, distribuir las zonas verdes en las ciudades y otros recursos como rutas de transporte público o ubicación de otros servicios, si un vehículo autónomo debe frenar o continuar y por qué ruta, qué precio se te cobra por un producto o servicio (y seguramente no es el mismo que para tu vecino), si se concede una libertad provisional o no…

Llegó la hora de supervisar todo esto. Son muchas, muchísimas, las voces que advierten de los problemas que ya se detectan.

The following list enumerates all the ethical issues that were identified from the case studies and the Delphi study, totalling 39.